Pět tisíc fotek bylo zdrojových v RAWu (DNG), každá navíc byla zvlášť upravena v Adobe Lightroomu pěti studenty fotografické školy. Vzorek je dostatečně pestrý, aby pojal všechny možné druhy fotografie, a zároveň se neuronová síť mohla na výběru pěti verzí naučit, v jakých mezích se při úpravě barevnosti a expozice pohybovat.

Nový algoritmus obraz nejprve sníží na rozlišení 256 × 256 px, díky tréninku z dřívějška odhadne vhodné úpravy, pak nasadí potřebné filtry a ony úpravy uloží jako matematický vzorec, který se pak zpětně aplikuje na původní obrázek ve vysokém rozlišení. Prostý popis problému má samozřejmě mnohem složitější pozadí. Metoda navržená v MIT ale funguje.

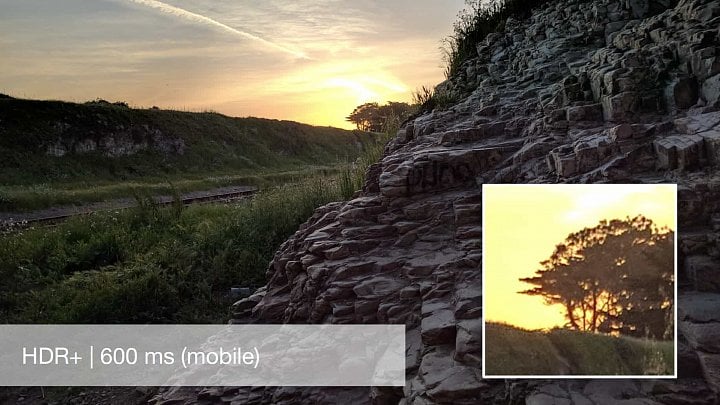

Na telefonu Google Pixel umožňuje v reálném čase upravovat obraz na displeji při rozlišení 1920 × 1080 px a 50 fps. Googlovský algoritmus HDR+ upravuje fotografii až po nasnímání, protože mu trvá operace trvá až 600 ms. Varianta z MIT, kterou Google pomohl dále optimalizovat, je desetkrát rychlejší. Tvůrci by už brzy měli vydat kód i prototyp aplikace pro Android, takže by se nový nápad mohl vyzkoušet každý.